Emotion A.I. – Empathisch personalisierte Interaktion zwischen KI und Autofahrer*innen

Computer sollen nicht nur explizite Signale des Menschen – wie Touchgesten, Klicks und Texteingaben – oder die Inhalte eines Sprachkommandos verarbeiten können, sondern auch den emotionalen Kontext einer Interaktion verstehen. Das Feedback des Computers, das auf die Stimmung oder Emotion eines menschlichen Nutzenden abgestimmt ist, ermöglicht dabei Emotion Artificial Intelligence (AI): die emotionale Intelligenz des Computers / der Maschine.

Das Projekt „Emotion AI“ baut auf dem Gedanken auf, dass die selbstverständlichen Interaktionen mit digitaler Technologie noch besser auf den einzelnen Menschen angepasst werden können, wenn sie auf die emotionale Verfassung des Nutzenden eingehen.

Ein technisches Schlagwort in diesem Zusammenhang ist „Affective Computing“: Es hat zum Ziel, Mensch-Computer-Interaktionen empathischer zu machen. Computer sollen nicht nur explizite Signale des Menschen wie Touchgesten, Klicks, Texteingaben oder den Inhalt eines Sprachkommandos verarbeiten können, sondern auch den emotionalen Kontext einer Interaktion verstehen und darauf angepasst reagieren. Das Feedback des Computers auf die Gemütslage der Nutzer*innen ermöglicht dabei „Emotion Artificial Intelligence“: die emotionale Intelligenz des Computers / der Maschine.

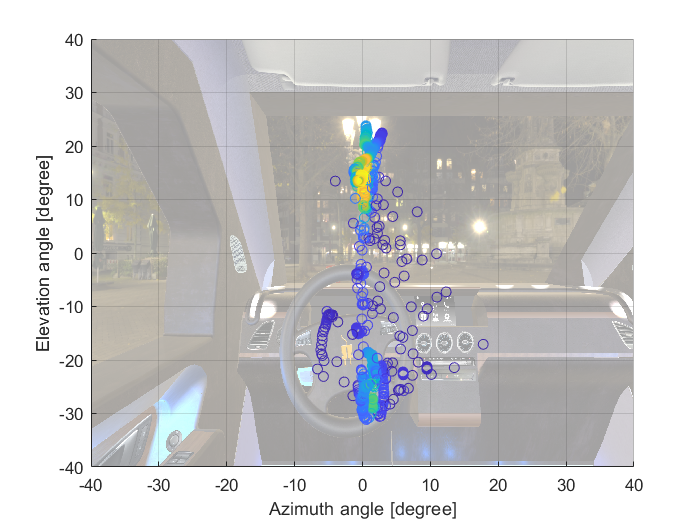

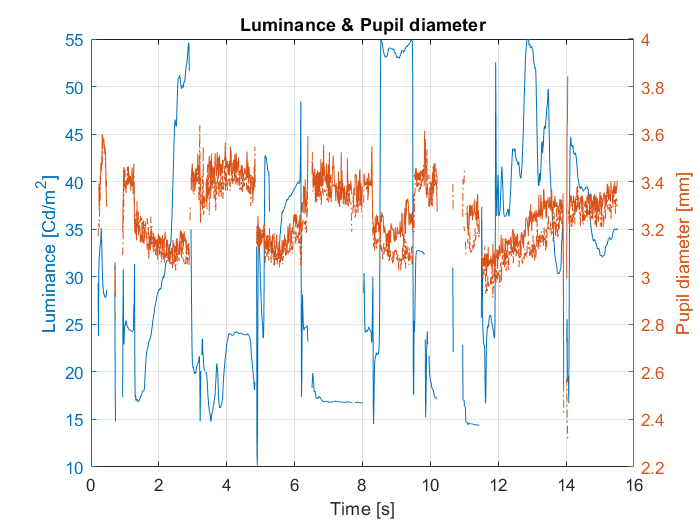

Nach einer intensiven Ideationsphase wählte sich das Projektteam den Case „Autofahrt“ zur intensiveren Bearbeitung aus. Im Zentrum der Forschung steht die Frage, wie intelligente Technologie Autofahrer*innen in unterschiedlichen Szenarien und Situationen unterstützen oder begleiten kann. Der Fokus liegt auf dem Erkennen und Interpretieren des Gemütszustandes der Autofahrer*innen durch eine KI und die optimale Maßnahmenergreifung. Dabei stehen die Warn- und Hinweistöne und deren Einfluss auf Komfort und Sicherheit, auch hinsichtlich der User Experience der Autofahrer*innen, im Zentrum. Denn eines ist jetzt schon klar: Das Auto der Zukunft geht auf die Bedürfnisse seiner Nutzer*innen ein und entwickelt sich zum persönlichen Assistenten mit passgenauen Angeboten und Unterstützung für Situationen aller Art.

Projektbeteiligte:

-

Prof. Dr. Alexander Hahn

Technische Hochschule Nürnberg, Fakultät Betriebswirtschaft

-

Prof. Dr.-Ing. Alexander von Hoffmann

Technische Hochschule Nürnberg, Fakultät Elektrotechnik Feinwerktechnik Informationstechnik

-

Prof. Markus Kaiser

Technische Hochschule Nürnberg, Fakultät Angewandte Mathematik, Physik und Allgemeinwissenschaften (Technikjournalismus)

-

Prof. Tilman Zitzmann

Technische Hochschule Nürnberg, Fakultät Design

Weiterführende Links:

Fotos: Emotion AI.